2025년 4월 14일 · 8 min read

텍스트는 손실이 큰 인터페이스다

느낄 순 있는데, 말로는 설명이 안 되는 것. 비주얼 의도를 언어로 옮기는 순간 놓치는 것들.

바이브: 느낄 순 있는데, 말로는 설명이 안 되는 것.

same.energy라는 비주얼 검색엔진이 있다. CLIP 임베딩 기반. 처음엔 그냥 트위터에 한 개발자가 올린 포스트를 보고 이게 무언가 하고 써봤는데, 몇 번 검색하다가 뭔가 발견했다.

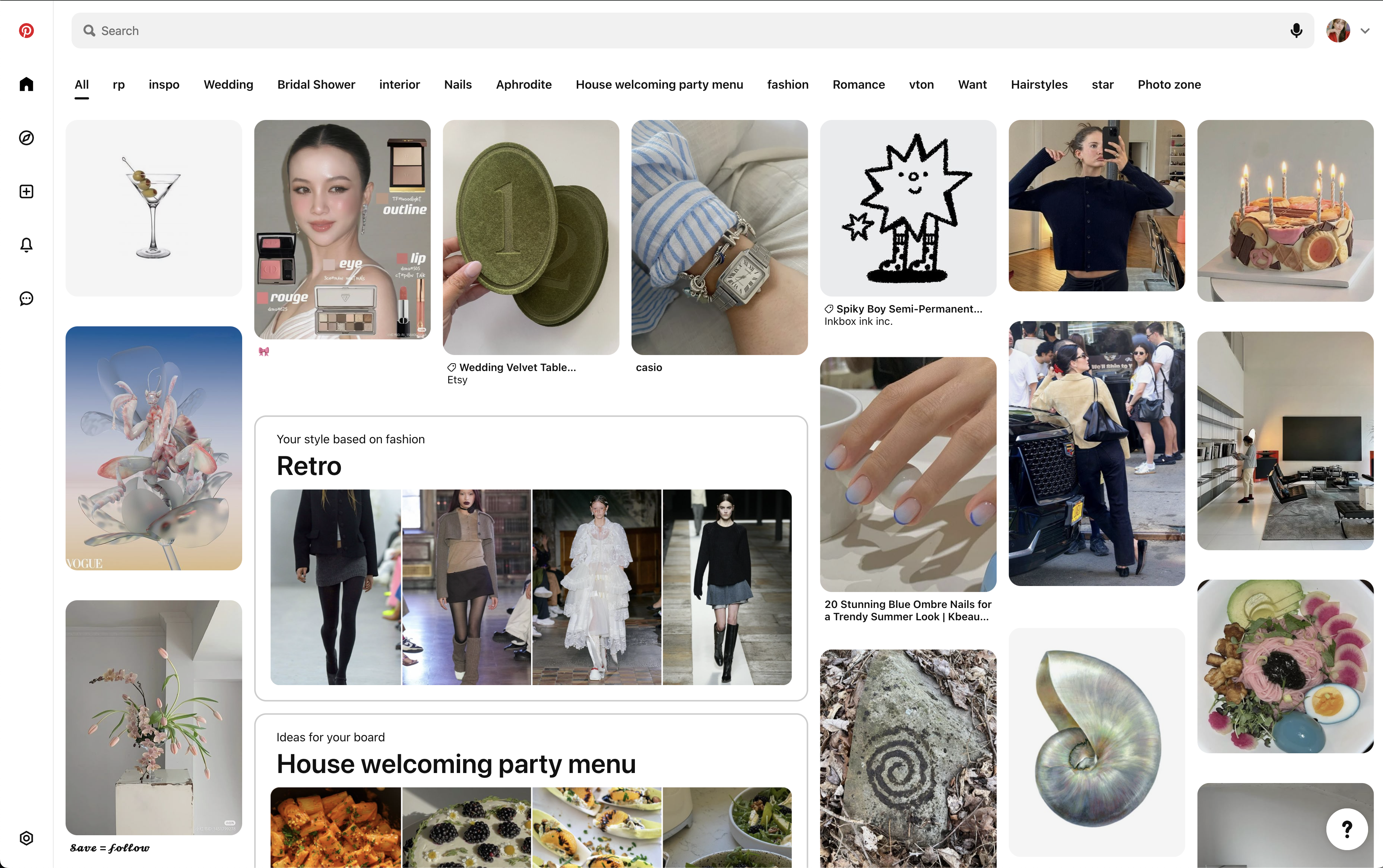

Pinterest는 "dreamy art"를 검색해보면 되게 다양한 걸 보여준다. 물고기도 나오고, 보트도 나오고, 발레리나도 나온다.

반대로 same.energy는 훨씬 집요하다. 한 번 잡은 주제를 거의 안 놓는다. 고독한 인물, 몽환적인 구도, 색감도 비슷한 계열. 스크롤을 내려도 계속 같은 무드가 유지된다.

여기서 좀 의문이 들었다. "어? 얘는 왜 같은 '느낌'에 대한 검색어에 이렇게까지 한 가지 주제만 파지?"

생각해보면 same.energy 방식도 틀린 건 아니다. "dreamy"라는 단어를 기준으로 사람들이 많이 연결해놓은 이미지들을 넓게 보여주는 거니까. 근데 Pinterest는 다른 걸 하고 있었다. 단어를 해석하는 게 아니라, 이미지 자체의 '느낌'을 따라가고 있었다.

이걸 보면서 좀 이상한 기분이 들었다. 내가 평소에 느끼던 거랑 비슷했기 때문이다.

나는 원래 비주얼로 먼저 이해하는 편이다. 어떤 장면이나 무드를 보면 설명보다 먼저 "아 이 느낌" 하고 와닿는다. 근데 그걸 말로 설명하려고 하면 항상 조금씩 어긋난다.

이건 특히 10대 때 더 크게 느꼈다. 영어권에서 살면서 내가 느낀 걸 영어로 설명해야 했는데, 뭘 봤는지는 말할 수 있었다. 근데 그걸 보면서 느낀 미묘한 차이는 항상 빠져나갔다. 표현은 가능했지만, 정확하지는 않았다.

그때는 그냥 "언어가 부족해서 그런가 보다" 했는데, 나중에 보니까 그게 아니었다. 언어 자체의 특성이었다.

회화나 사진을 보면 작가는 말로 설명하지 않는다. 색, 구도, 리듬, 질감 같은 걸로 그냥 느끼게 만든다. 근데 그걸 보는 사람은 각자 다르게 받아들인다. 그 사이에는 항상 설명되지 않는 영역이 남는다.

문제는 AI 이미지 생성으로 오면서 생긴다. 이제 우리는 그 설명 안 되는 영역까지 말로 컨트롤하려고 한다.

text-to-image를 쓰는 과정을 보면 이렇다.

- 머릿속에 이미지가 떠오른다

- 그걸 텍스트로 바꾼다

- 모델이 그걸 다시 이미지로 만든다

이 과정에서 무언가 계속 놓치고 만다.

많은 사람들이 여기서 "프롬프트를 더 잘 써야 하나?"라고 생각한다. 근데 몇 번 해보면 느껴진다. 이건 실력 문제가 아니라 구조적 문제다. 지금 우리는 비주얼 시스템을 언어 인터페이스로 조종하고 있다. 애초에 채널이 다르다.

그래서 다음과 같은 문제가 생긴다. 레퍼런스를 넣고, ControlNet을 써도 결과가 "거의 맞는데 뭔가 다른" 느낌. 명확하게 틀린 건 아닌데, 원했던 그 감각은 아니다.

이걸 한 문장으로 정리하면 이거다.

텍스트는 비주얼 의도를 전달하기엔 손실이 있는 인터페이스다.

이 생각을 2025년 4월에 처음 정리했다. 그때 질문은 단순했다. "그럼 텍스트를 안 거치면 되지 않나?"

그래서 aether studio를 만들었다.

핵심 아이디어는 어렵지 않다. 텍스트를 없앤 게 아니라, 중심에서 내려놨다.

대신 이렇게 한다. 무한 캔버스 위에 레퍼런스 이미지를 쭉 깐다. 포즈, 의상, 무드, 컬러. 그리고 그걸 보면서 말은 보조로만 쓴다.

"여기 느낌 유지하고 더 가까이" "이 인물은 빼고, 분위기만 가져가" "조금 더 차갑게"

이 방식의 차이는 명확하다. AI가 텍스트만 보고 상상하는 게 아니라, 이미지를 같이 보면서 이해한다. 이미지 배치 자체가 이미 설명이 된다.

실제로 해보면 체감이 확 온다. 예를 들어 Spotify 커버를 만든다고 하면, 보통은 프롬프트를 계속 바꿔가면서 괜찮은 결과가 나올 때까지 반복한다. 근데 여기서는 다르게 간다. 레퍼런스에서 시작해서 한 단계씩 쌓아간다.

6단계 정도 지나면 완전히 다른 결과가 아니라, 의도한 방향으로 정제된 결과가 나온다.

그리고 이 과정에서 중요한 게 하나 더 있다. 모든 과정이 남는다. 보통은 이전 결과는 버려지고 다음 결과만 남는다. 근데 여기서는 시도했던 방향, 마음에 안 들어서 버린 것, 조금 수정해서 살린 버전 — 이게 다 그래프로 남는다.

그래서 작업이 "운"이 아니라 "의사결정의 기록"이 된다.

이걸 길게 밀어보면 어떻게 되냐면, 뉴욕에서 서울까지 이어지는 21장짜리 룩북도 한 세션에서 나온다. 이전 맥락이 계속 쌓이기 때문이다. 프롬프트 하나하나가 아니라, 전체 흐름이 이어진다.

정리하면 이거다. 우리는 지금까지 이미지를 만들 때 언어를 중심에 두고 있었다. 근데 사실은 반대다. 텍스트는 보조고, 이미지가 중심이어야 한다.

텍스트는 손실이고, 캔버스는 아니다.